Sadorimatsu

Проверенные

- Сообщения

- 790

- Решения

- 22

- Реакции

- 586

- Баллы

- 1,805

Sadorimatsu добавил(а) новый ресурс:

robots.txt - Инструкции и секреты настройки - Пособие для чайников по настройке robots.txt на XenForo 2+

Узнать больше об этом ресурсе...

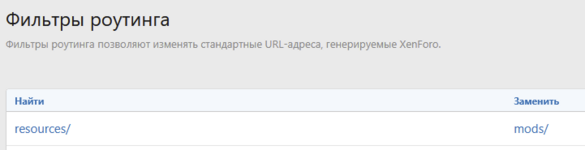

robots.txt - Инструкции и секреты настройки - Пособие для чайников по настройке robots.txt на XenForo 2+

В этом мануале дам все доступные варианты и наработки по шаблонам robots.txt и на каждом будет расписаны варианты настроек и предложений.

Базовые термины: (С чем работаем)

- Краулер (Crawler) / Робот (Bot):

Программа поисковой системы, которая сканирует страницы сайта и переходит по ссылкам. Примеры: Googlebot (Google), YandexBot (Яндекс), Bingbot (Bing) и т.д.- Индексация (канонические URL):

Процесс добавления информации о странице в...

Узнать больше об этом ресурсе...